الولايات المتحدة – جسور- فاطمة الزهراء بدوي

يتحول الذكاء الاصطناعي في أماكن العمل الأمريكية، من أداة تقنية، إلى قضية قانونية معقدة، خاصةً في مجالات الإجازات، والإعاقة، وإدارة الغياب.

في حلقة خاصة من بودكاست We Get AI for Work™، أجرى المحامي جوزيف لازاروتي حوارًا معمقًا، مع بريون باس، الرئيس التنفيذي لتحالف إدارة الإعاقة، في أماكن العمل (DMEC)، حول التحديات القانونية والأخلاقية المرتبطة باستخدام الذكاء الاصطناعي، في قرارات العمل.

أكد الأخير أن تسارع تطور التكنولوجيا يصاحبه قلق متزايد، من تضارب محتمل مع التشريعات الفيدرالية والولائية.،فأي أداة ذكاء اصطناعي تُستخدم لتحديد أهلية الموظف لإجازة مرضية مثلًا، قد تقع في فخ التمييز أو الانتقاص من الحقوق المكفولة، بموجب قانون الإجازات الطبية (FMLA).

وأضاف أن وزارة العمل الأمريكية حذرت من استخدام أدوات الذكاء الاصطناعي لاتخاذ قرارات نهائية تتعلق بصحة الموظفين، أو مدى استحقاقهم للإجازة. وأشار إلى أن القوانين الولائية أصبحت أكثر صرامة، فبعضها يمنع استخدام بيانات الموظفين دون إذن صريح، مما يزيد من تعقيد مهمة إدارات الموارد البشرية.

من جانب آخر، ناقش لازاروتي وباس مشروع القانون المعروف باسم “One Big Beautiful Bill Act”، الذي يقترح فرض حظر لمدة عشر سنوات على استخدام الذكاء الاصطناعي في قرارات التوظيف. إلا أن باس أبدى شكوكه في قانونية هذا المقترح على المستوى الفيدرالي، وتوقع مقاومة قوية من ولايات مثل كاليفورنيا ونيويورك.

وفي محاولة لفهم واقع الاستخدام الفعلي للذكاء الاصطناعي، أطلق تحالف DMEC “مختبر تفكير” ضم 130 متخصصًا من أرباب العمل والخبراء التقنيين. وكشفت نتائج الاستطلاع أن 60٪ فقط من المشاركين لديهم فهم أساسي للذكاء الاصطناعي، في حين ربط 85٪ بين استخدامه وبين تحسين الكفاءة.

لكن التحديات باتت واضحة، وأهمها غياب السياسات الواضحة، وتعقيدات دمج الأنظمة، وغموض آلية اتخاذ القرار. نحو 30٪ فقط من المشاركين أكدوا وجود سياسات رسمية في مؤسساتهم لاستخدام الذكاء الاصطناعي في القرارات المتعلقة بالمزايا.

أعرب باس عن قلقه من اعتماد بعض المؤسسات على أدوات مراقبة الأداء، خاصة للموظفين من ذوي الإعاقات، مثل من يعانون من ضعف البصر أو مشاكل حركية. إذ قد تُظهر هذه الأدوات تراجعًا في الأداء دون إدراكها للسياق الشخصي لكل موظف، مما يعرض الشركات لخطر الوقوع في ممارسات تمييزية.

وأوضح أن أدوات مثل “Copilot” من مايكروسوفت أظهرت تطورًا ملحوظًا في مجال التلخيص دون تسجيل كامل للنقاشات، مما يقلل من احتمالية تسريب البيانات الحساسة. مشيرًا إلى أهمية التحكم في قواعد بيانات الذكاء الاصطناعي ومنع وصوله إلى معلومات شديدة الخصوصية كملفات الموارد البشرية.

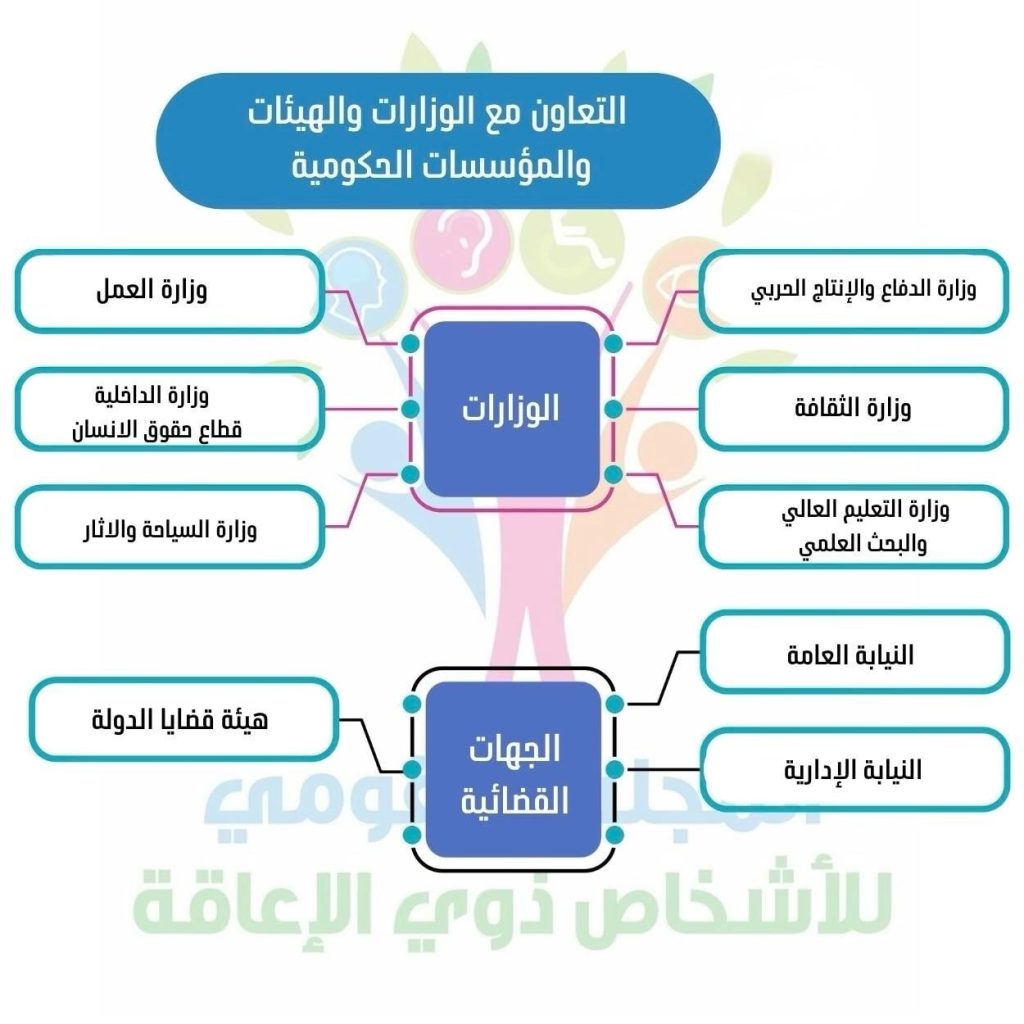

في ختام الحوار، شدد على ضرورة إنشاء أطر أخلاقية واضحة، وتقديم أدوات عملية، وطرح دراسات حالة تساعد أرباب العمل على استخدام الذكاء الاصطناعي بطريقة عادلة وقانونية، وخاصة في مجالات الإعاقة والحقوق الصحية للعاملين.

.png)